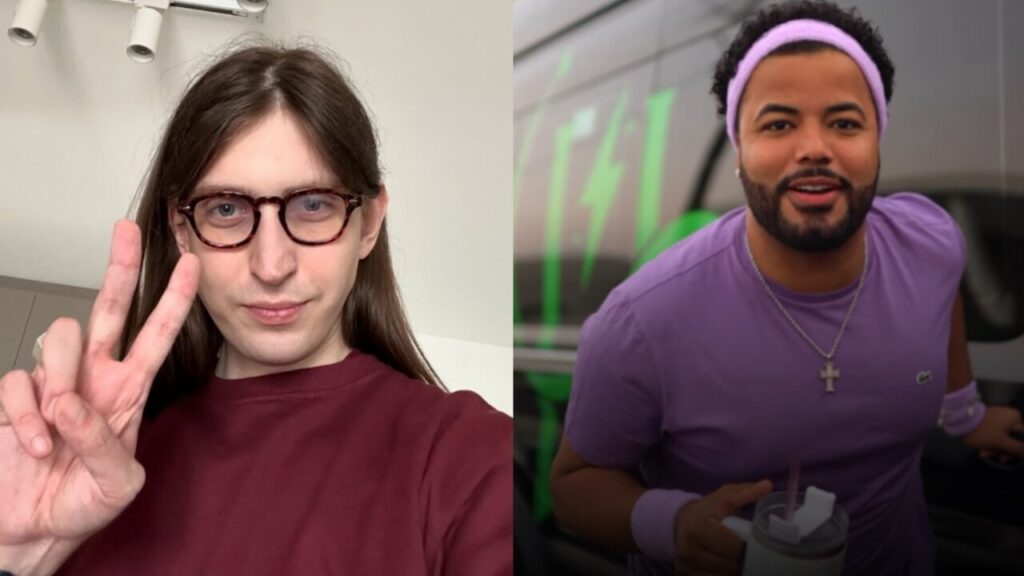

Em um vídeo que rapidamente se tornou viral, o youtuber Felca trouxe à luz preocupações sérias sobre a influência que os algoritmos das redes sociais podem ter na promoção de conteúdo impróprio envolvendo crianças. Chamando a atenção do público e das plataformas, Felca cunhou o termo “algoritmo P” para descrever como os sistemas de recomendação podem, inadvertidamente, contribuir para a adultização e exploração de crianças na internet. O caso chamou a atenção para a ética na produção de conteúdo online, impulsionado pelo exemplo do influenciador digital Hytalo Santos.

Como Felca explicou a situação?

sobre adultização pic.twitter.com/oPJkoFROhE

— Felca #seita (@Felcca) August 9, 2025

Os algoritmos desempenham um papel crucial nos bastidores das redes sociais, determinando que tipo de conteúdo é apresentado a cada usuário. Projetado para maximizar o tempo de uso e aumentar o engajamento, esses sistemas utilizam padrões de comportamento dos usuários para sugerir novos vídeos e postagens. No entanto, ao fazer isso, o algoritmo pode potencialmente reforçar comportamentos indesejados ou perigosos, ao não ter um filtro ético robusto capaz de diferenciar engajamento saudável de atividades prejudiciais.

No vídeo viral, Felca destaca como o algoritmo das plataformas sociais pode ser manipulado para promover a exposição de crianças em contextos inadequados. Ao detectar um padrão de visualização de vídeos de crianças em situações sugestivas, o sistema recomenda automaticamente mais desse tipo de conteúdo para usuários com o mesmo perfil de interesse. Ao fazer isso, não só alimenta um ciclo vicioso como também abre precedentes para que predadores identifiquem e explorem vídeos, ampliando sua visibilidade e potencializando o problema.

Como a denúncia de Felca impactou as redes sociais?

A denúncia de Felca levantou discussões sobre os limites éticos na curadoria de conteúdo online. As críticas não são apenas dirigidas ao funcionamento do algoritmo em si, mas também à aparente inação das plataformas, que, segundo ele, têm a capacidade de intervir, mas não o fazem em prol de maiores visualizações e, consequentemente, lucros. A monetização desse tipo de conteúdo é vista como um indicador dessa negligência, piorando a situação. O questionamento ético que se coloca é sobre até que ponto as plataformas devem ser responsáveis pelo conteúdo promovido por seus algoritmos e qual o papel delas na proteção de menores.

- Mobilização e Debate: O vídeo viralizou rapidamente, acumulando milhões de visualizações e comentários. O tema da exploração infantil e da “adultização” de crianças na internet, antes restrito a discussões pontuais, ganhou destaque e se tornou um assunto central nas plataformas.

- Consequências Diretas para o Denunciado: A denúncia de Felca, que apontou práticas de exposição de crianças em situações impróprias, levou à desativação do perfil de Hytalo Santos no Instagram. Além disso, o Ministério Público da Paraíba (MPPB) iniciou uma investigação sobre o caso.

- Apoio de Outros Influenciadores e Figuras Públicas: A coragem de Felca em abordar um tema tão sensível e “mexer nesse vespeiro”, como ele mesmo disse, gerou apoio de outros grandes influenciadores, como Felipe Neto, e até mesmo de políticos. O deputado Hugo Motta, por exemplo, citou o vídeo e prometeu pautar projetos de lei sobre a proteção de crianças e adolescentes na internet na Câmara.

- Atenção para o Perigo da Pedofilia: A denúncia de Felca não se limitou a questionar a conduta do influenciador, mas também alertou para a presença de pedófilos no público que consome esse tipo de conteúdo, ressaltando o risco real a que as crianças estão expostas.

- Mudança na Imagem de Felca: Conhecido por seu humor e vídeos descontraídos, Felca utilizou seu alcance para abordar uma questão séria, mostrando uma nova faceta de seu trabalho e reforçando a responsabilidade que grandes criadores de conteúdo têm. Ele inclusive relatou ter contratado seguranças e usado carros blindados após a denúncia.

Quais soluções podem ser implementadas?

Para mitigar o problema do “algoritmo P”, as plataformas de mídia social precisam considerar a implementação de sistemas de verificação de conteúdo mais robustos e éticos. Algoritmos aprimorados com filtros morais e tecnologia de inteligência artificial que consigam diferenciar engajamento legítimo de interações prejudiciais poderiam ser uma solução eficaz. Além disso, transparência em como esses algoritmos operam e a inclusão ativa de especialistas em psicologia infantil para orientar diretrizes de conteúdo são passos importantes.

A responsabilização das plataformas é imprescindível para a proteção das crianças na internet. O caso evidenciado por Felca não é um incidente isolado, mas um sintoma grave de problemas maiores que precisam de atenção imediata. Enquanto o debate continua, a esperança é que plataformas e criadores de conteúdo assumam um papel mais proativo na criação de um ambiente digital seguro e ético para todas as idades.